Humanity’s Last Exam è l’esame finale per “mettere alla prova” le varie intelligenze artificiali, ma come funziona di preciso?

Negli ultimi anni i sistemi di intelligenza artificiale hanno iniziato a ottenere risultati altissimi nei benchmark accademici tradizionali. Questo successo, però, ha fatto emergere un problema: molti dei test che un tempo rappresentavano una sfida reale oggi non sono più sufficienti per misurare le capacità dei modelli più avanzati.

Valutazioni note come il Massive Multitask Language Understanding (MMLU), un tempo considerate particolarmente impegnative, faticano ormai a distinguere tra diversi livelli di performance delle IA moderne. In altre parole, i test sono diventati troppo facili.

Per affrontare questa situazione, quasi 1.000 ricercatori da tutto il mondo – tra cui il professor Tung Nguyen della Texas A&M University – hanno sviluppato un nuovo benchmark pensato per essere molto più ampio, difficile e ancorato alla conoscenza specialistica umana.

Che cos’è Humanity’s Last Exam

Il risultato del progetto è Humanity’s Last Exam (HLE): un esame composto da circa 2.500 domande che spaziano tra matematica, discipline umanistiche, scienze naturali, lingue antiche e numerosi ambiti altamente specializzati.

Il lavoro è descritto in uno studio pubblicato su Nature, mentre ulteriori dettagli sono disponibili sul sito ufficiale del progetto.

Nguyen, che ha contribuito alla stesura di molte domande, sottolinea un punto chiave: “Quando l’IA ottiene risultati eccellenti nei benchmark umani, è facile pensare che si stia avvicinando a una comprensione di livello umano. Ma l’intelligenza non è solo riconoscimento di schemi: è profondità, contesto e competenza specialistica.”

L’obiettivo dell’esame non è “battere” i partecipanti umani, ma identificare con precisione le aree in cui l’IA continua a mostrare limiti.

Uno sforzo globale per misurare i limiti dell’IA

Le domande di Humanity’s Last Exam sono state scritte e revisionate da specialisti di tutto il mondo. Ogni quesito è stato progettato con una sola risposta verificabile e costruito in modo da evitare soluzioni rapide tramite semplici ricerche online.

Gli argomenti includono sfide accademiche avanzate: dalla traduzione di iscrizioni palmirene antiche all’identificazione di minuscole strutture anatomiche negli uccelli, fino all’analisi dettagliata della pronuncia dell’ebraico biblico.

Un aspetto particolarmente interessante è il processo di selezione: ogni domanda è stata testata sui principali modelli di IA e, se un sistema riusciva a rispondere correttamente, veniva eliminata dall’esame finale. In questo modo il benchmark resta leggermente oltre ciò che le IA attuali riescono a risolvere con affidabilità.

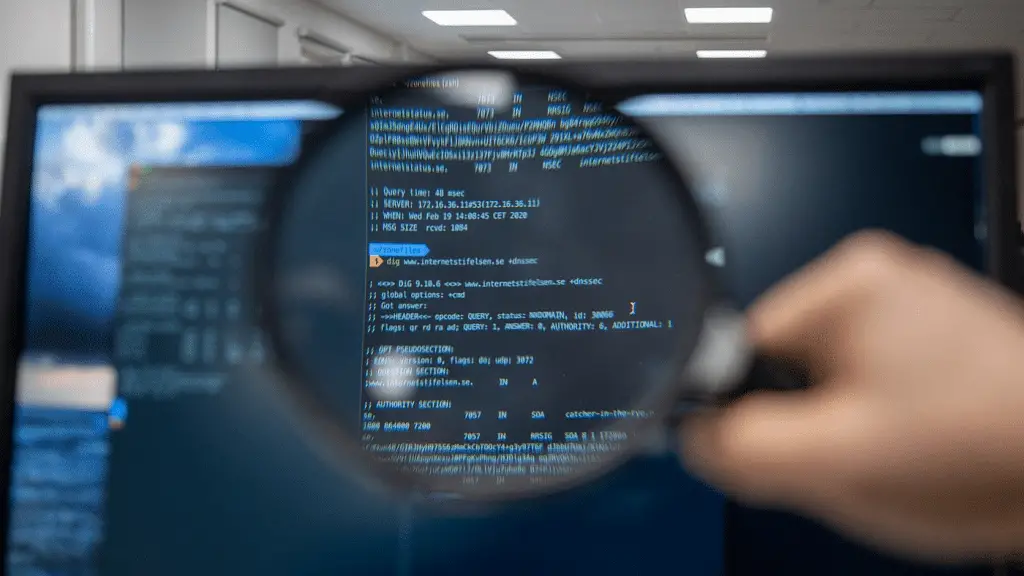

I risultati iniziali confermano l’efficacia dell’approccio:

- GPT-4o ha ottenuto il 2,7%

- Claude 3.5 Sonnet il 4,1%

- OpenAI o1 circa l’8%

- I sistemi più avanzati, come Gemini 3.1 Pro e Claude Opus 4.6, hanno raggiunto tra il 40% e il 50%

Perché servono nuovi benchmark

Secondo Nguyen, la necessità di aggiornare i benchmark non è solo una questione tecnica. Senza strumenti di valutazione affidabili, sviluppatori, decisori politici e utenti rischiano di sopravvalutare ciò che l’IA è realmente in grado di fare.

I benchmark tradizionali, infatti, misurano spesso la capacità di completare compiti progettati per studenti umani, ma non catturano necessariamente la comprensione profonda o la competenza specialistica.

Non una minaccia, ma uno strumento

Nonostante il nome suggestivo, Humanity’s Last Exam non intende suggerire che l’uomo stia diventando obsoleto. Al contrario, mette in evidenza quanto resti ancora unico del sapere umano.

“Non è una corsa contro l’IA”, spiega Nguyen. “È un modo per capire dove questi sistemi funzionano bene e dove invece faticano. Questo ci aiuta a costruire tecnologie più sicure e affidabili.”

Un benchmark pensato per il futuro

HLE è progettato per durare nel tempo come riferimento trasparente per valutare i sistemi futuri. Alcune domande sono state rese pubbliche, mentre la maggior parte resta nascosta per evitare che i modelli possano semplicemente memorizzarle.

Secondo Nguyen, al momento Humanity’s Last Exam rappresenta una delle misure più chiare del divario tra intelligenza artificiale e intelligenza umana: un divario che, nonostante i progressi, resta significativo.

Una collaborazione su scala globale

Il progetto dimostra anche il valore della collaborazione interdisciplinare: informatici, storici, fisici, linguisti e ricercatori medici hanno contribuito insieme.

E forse il dato più interessante è proprio questo: a evidenziare i limiti dell’IA, almeno per ora, sono stati ancora una volta gli esseri umani lavorando insieme.