Sarà capitato sicuramente anche a te, magari durante una sessione di un gioco competitivo online, di incappare in qualche “simpatico” che ti ha insultato o deriso; a tal proposito Intel vuole limitare gli insulti online tra videogiocatori tramite l’implementazione di un’AI dedicata.

Chiunque abbia giocato a un gioco competitivo online per più di poche ore –e con utenti casuali invece che amici– ha probabilmente incontrato qualche idiota che in gergo faceva “trash-talking“, il quale nel suo modo migliore è un punto fermo dei giochi online e può anche essere divertente, tuttavia nel peggiore dei casi, può portare a tossicità e molestie, che Intel sta cercando di combattere usando la potenza dell’IA.

Come Intel vuole limitare gli insulti online nei videogame

Se sei stanco dei giocatori online che urlano insulti razzisti o sessisti mentre giochi, Intel vuole limitare gli insulti online, ma come? L’azienda si sta preparando a lanciare un nuovo programma che può aiutare gli utenti a filtrare automaticamente il linguaggio offensivo dalle loro chat vocali in-game.

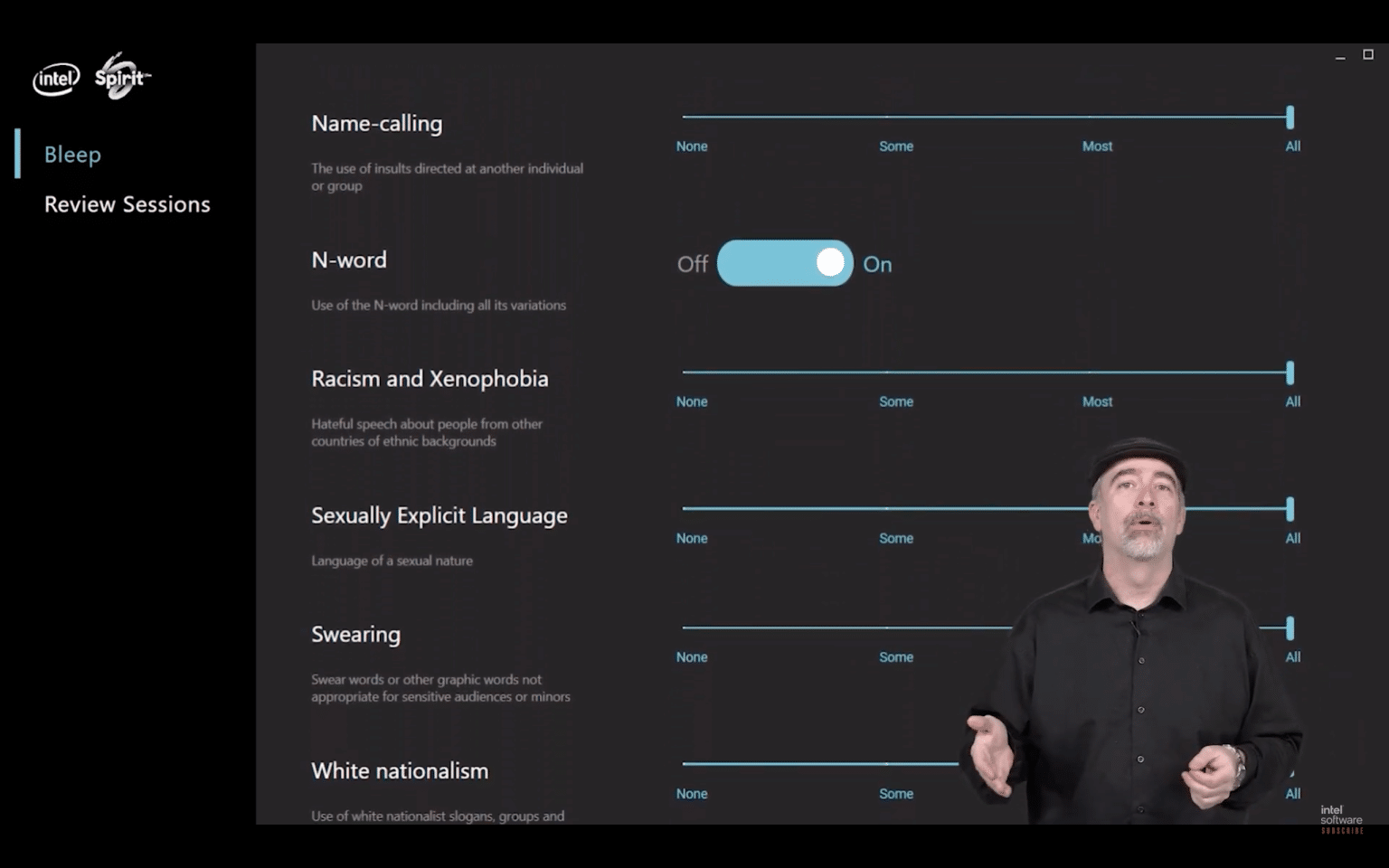

Il produttore di hardware ha creato un software chiamato “Bleep“, che utilizza l’apprendimento automatico per filtrare il linguaggio sgradevole sulla chat vocale. Bleep ovviamente sarà facoltativo -come ti dicevo prima il trash-talking, se usato bene, è divertente– con Intel che offre agli utenti Bleep un alto grado di controllo sulla loro esperienza.

Intel ha mostrato alcuni screenshot di Bleep durante l’evento GDC Showcase e, anche se non ha fornito una demo, in base alle immagini del video sembrerebbe che Bleep possa riconoscere e rimuovere immediatamente le parole offensive in una chat in tempo reale.

Come dicevo, anche se Intel vuole limitare gli insulti online tra videogiocatori, darà la possibilità di regolare queste “censure” il più possibile, così da non rovinare l’esperienza: potrai selezionare tra tre modalità di “Bleep” ovvero Some, Most o All e ciò andrà a modificare i filtri per le chat.

Quello che sentirai quando una parola viene oscurata rimane poco chiaro, ma sarai in grado di controllare quanto linguaggio tossico viene filtrato e per quali categorie, tra cui “misoginia“, “parolacce“, “abilità e vergogna del corpo“, “nazionalismo bianco“, “N-Word“, e molti altri.

L’idea del progetto con cui Intel vuole limitare gli insulti online è nato ben due anni fa, il produttore di chip ha collaborato infatti con Spirit AI, una società che sta sviluppando strumenti per identificare e rimuovere il linguaggio offensivo basato su testo nelle sessioni di gioco.

A quel tempo, il progetto era ancora uno dei primi prototipi, ora Intel dice che si sta preparando a rilasciare il programma come beta.

“Sebbene riconosciamo che soluzioni come Bleep non eliminano il problema, riteniamo che sia il passo nella giusta direzione, offrendo ai giocatori uno strumento per controllare la loro esperienza”

ha affermato Roger Chandler, Vice President di Intel.

Come ti dicevo, alcuni sostengono che le battute e gli insulti fanno parte dell’esperienza di gioco online, e potrebbero anche avere ragione, ma Intel afferma che quasi un quarto dei giocatori (22%) abbandona i giochi a causa di molestie e tossicità.

Per motivi di trasparenza, la percentuale sopra citata proviene da un sondaggio condotto dalla Anti Defamation League nel novembre 2020, la quale ha utilizzato un campione di 1.000 giocatori con sede negli Stati Uniti di età compresa tra 18 e 45 anni.

Il resoconto finale è che Intel vuole limitare gli insulti online il prima possibile e Bleep verrà lanciato entro la fine dell’anno e sembra che sarà disponibile gratuitamente per tutti, o almeno per tutti coloro che eseguono un sistema basato su Intel.